作者:VRPinea

该文章首发于2018年6月8日

大家知道,谷歌参与的美国军事AI项目(Project Maven),一直遭受着包括公司内部科技巨头在内的上千名员工的抗议,事件持续发酵,甚至蔓延到公众。随后新任谷歌AI负责人Jeff Dean表示:“谷歌不应该涉足自动化武器开发业务。”本月初,谷歌宣布停止续签Project Maven的合同。

而今天,谷歌终于正式亮明态度,其CEO桑德尔·皮查伊(Sundar Pichai)发布了谷歌使用AI的七项原则。除了提到不会将AI技术应用于开发武器外,《原则》还包括:不会违反人权准则将AI用于监视和收集信息;避免AI造成或加剧社会不公等。

用皮查伊的话说就是:“AI能帮助人们完成许多事情,这是我们致力于AI研发的原因。但这种强大的技术也会带来问题。”

今天,小编就结合近期发生的一系列事情,和大家探讨下AI当前所面临的首要问题:隐私泄露。

近期AI隐私泄露事件回顾

继“Facebook泄露门事件”后,近日,脸书又因为隐私泄露事件再次登上头条。然而,无独有偶,AI隐私泄露事件时有出现。小编先带大家简单回顾下。

Facebook AI的“道与魔”:帮助与出卖

据悉,Facebook正在尝试使用AI和模式识别等技术,来识别具有自杀倾向的用户。Facebook 的新型“主动检测”AI技术,可扫描所有帖子中潜在的自杀念头,并在必要时将有关心理健康的资源,发送给存在自杀风险的用户或他们的朋友。甚至,会联系当地的紧急热线,以帮助用户。

据一项数据显示,全球每40秒便有一人自杀,自杀已成为青少年死亡的第二大原因。就这一点来考虑,Facebook利用AI技术提前预防用户自杀,是在服务大众,做着有意义的事。而仅出于这一点,人们不会随意地将其与隐私泄露联系在一起。然而,“迫不及待”打脸的却是Facebook自己,没错,又一次打脸。

继“Facebook泄露门事件”后(用户数据被泄露,并被用于总统大选期的定向宣传),近日,其又发生一件隐私泄露事件。

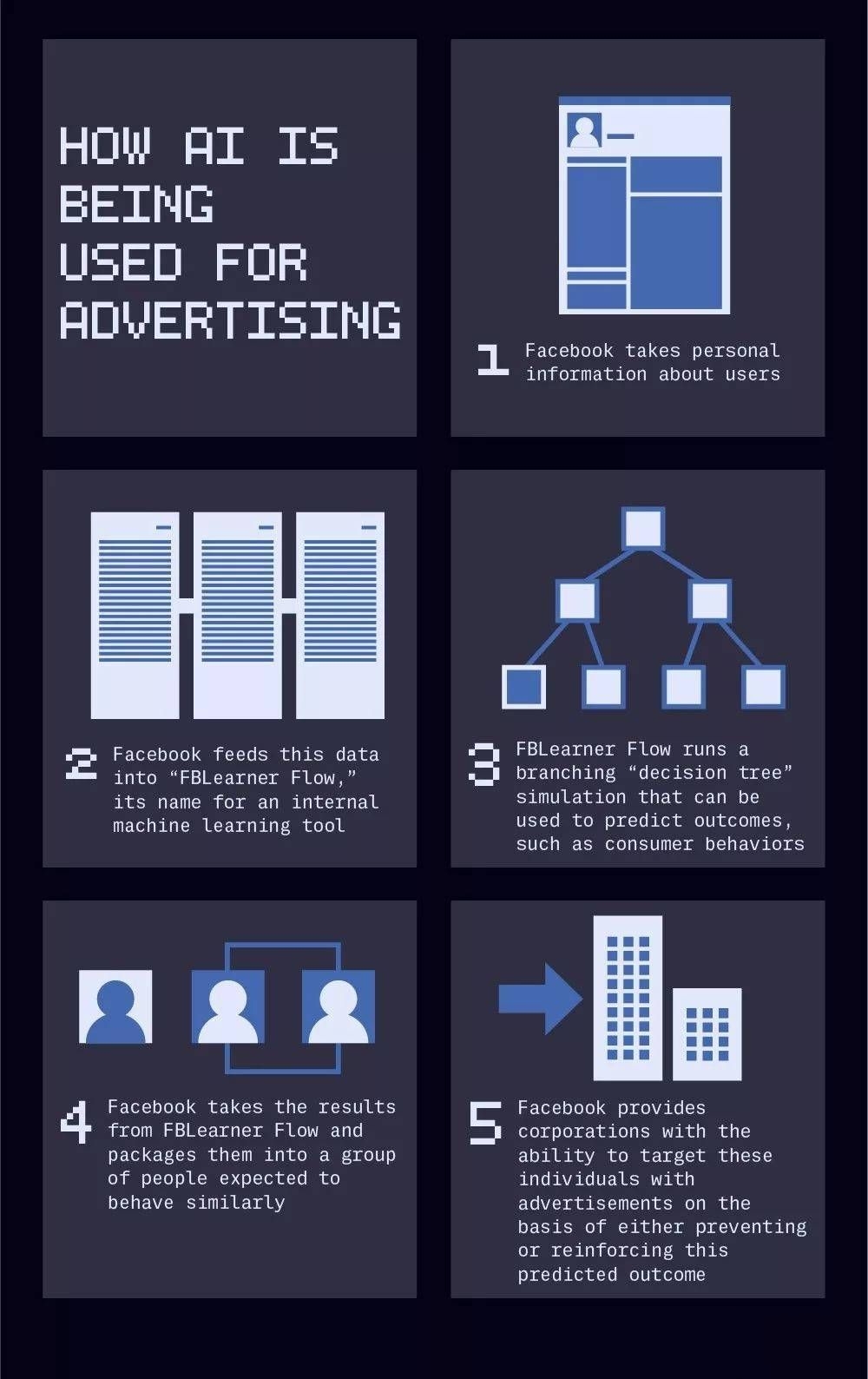

Facebook如何用AI来精准投放广告

据悉,美国媒体The Intercept最新获取了一份Facebook机密文件,透露出Facebook提供给广告主的特殊服务:忠诚度预测。这是一项基于AI的服务,即预测用户的未来行为,作为广告投放的依据。

而“忠诚度预测”依靠的数据有:用户位置、设备信息、所连接Wi-Fi网络的情况、观看的视频记录、亲朋好友的各种细节,甚至是和朋友聊天的内容。这些数据,无疑已经触及到了用户的底线。

然而,与之相比,世界范围内的AI隐私泄露,似乎更无底线的样子?

无独有偶,AI隐私泄露不止于Facebook

Facebook的AI隐私泄露事件,之所以扩散到被大众快速知道,在于其知名度以及过往的黑历史。然而,AI隐私泄露并非独此一家。

去年5月,谷歌旗下的DeepMind获取了,英国皇家慈济NHS信托基金运营的三家医院的160万病人的NHS(英国国家医疗服务体系),其中包括HIV感染状况、过去的吸毒量和堕胎信息等私密数据。

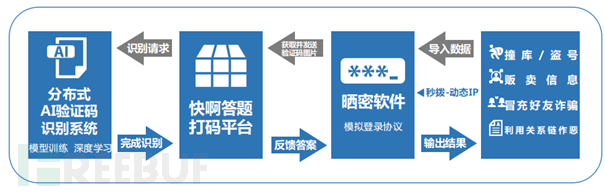

就国内而言,同年9月也发一件重大事件:浙江绍兴警方查封了市场上最大的打码平台“快啊”平台,并公布该平台利用AI技术,窃取了10亿多组公民个人信息。据悉,“快啊”平台有一个破解、窃取、贩卖和盗用个人信息,以实施诈骗的完整链条,其中AI技术运用在识别验证码这个环节。

再说近日,微博用户“互联网阿超”晒出一张截图显示:其某条微博点赞量超过3000万,而他的微博粉丝却只有1万人。这正是因为微博的Timeline不再只是基于关注,而是与AI算法结合起来。每一个内容都有被算法推荐,进而有曝光和爆发的机会。

但这也意味着隐私泄露的可能。因为部分用户可能主观上,并不想让自己发表的言论被更多人知道,甚至随着信息的扩散,带来的一些后续事情,还会影响到其正常生活。

而上述提到的几例关于AI隐私泄露的事件,让人不得不思考这么一个问题:我们能否让AI服务于人们的生活与工作的同时,又能避免其犯错,例如泄露用户隐私。

其实理解AI,和AI“理解”人类,同样重要

首先要肯定的是,随着技术的发展,AI在人们工作与生活中扮演着越来越多、越来越重要的角色,有存在的合理与必然性,其所带来的价值无疑是巨大的。例如,提高数据处理效率,改变行业等。因而对于AI隐私泄露的这一隐患,人们只能正视、想办法解决问题,而非漠视、逃避或其他。

而要提高工作与生活的效率,观察并详细记录用户日常生活中的行为表现,收集、整理分析,并管理这些信息,也是 AI需要做的事。那么,用户的隐私数据该如何保护?

对此,国内外部分企业,都在不断地努力尝试,以解决这方面问题。

不断成立的AI伦理委员会:透明性是关键

2016年微软成立AI伦理委员会“AETHER”,把全公司的产品部门、业务部门,还有更重要的法务部门集合在一起,以讨论和解决AI相关问题。

同年,亚马逊、微软、谷歌、IBM和Facebook,联合成立非营利性的人工智能合作组织“Partnership on AI”(苹果于2017年1月加入该组织)。该联盟为开发AI系统的公司,提供了一个沟通平台,让各方在一些有可能对全人类,造成巨大损害的问题上,寻求共同点。

然而,很明显,仅仅建立AI伦理委员,并不能消除人们对AI隐私透露等问题的担忧。因为实际上,除了知道该委员会成立了,具体的人们一无所知。例如,其究竟研究哪些工作?解决了哪些问题?有什么重要的成果?似乎一直是被讳莫如深的(或者说,没看到实效)。

对此,小编认为,AI相关技术和工作进展的透明性,也很重要。而麻省理工学院媒体实验室的总监伊藤穰的看法,或许道出了关键:“需要将AI领域内发生的事情,传达给关注AI未来的人。如果没有对AI技术的理解,律师、决策者和一般公众,就很难真正理解或想象AI的可能性和风险。”当然,也就无法更有效地避免或解决,类似AI隐私透露等问题。

知乎算法机器人“瓦力”:机器学习的可控性

不仅仅是国外,国内对解决AI隐私泄露等问题也在寻求解决之道。例如,知乎的算法机器人“瓦力”,可实时高效处理多种场景,包含贴标签、辱骂和歧视等各种不友善行为,努力减少低质和无关内容对普通用户的干扰。

而华为很早就开始布局,智慧手机云+端的隐私防护。发布麒麟970等人工智能芯片。拥有强大的AI运算性能,并提供一整套的用户隐私保护体系。华为消费者业务CEO余承东曾表示:“未来AI在终端上的实现,必须要通过端云协同。”

在此,不得不提及霍金曾提出的:“AI的真正风险不是恶意,而是能力。一个超级聪明的AI会非常擅长实现它的目标。如果这些目标与我们的目标不一致,我们就有麻烦了。”

上述这些,多少都体现出AI算法的重要角色。要知道AI是依赖于机器学习(深度学习)算法的,是需要大规模训练数据的。那么,如何搜集数据、提供怎样的数据,最终赋予AI怎样的“判断力”,让其更好地理解人类,避免无意识地犯错,减少隐私泄露、歧视等问题的发生,也是应当被着重考虑的问题。

面对当前AI所面临的隐私泄露等问题,小编认为,当前最能理解AI的,还要数运用这一技术的公司及其技术人员,因而相较于普通人,他们无疑更应当承担起让AI更好地“理解”人类的责任。

正如扎克伯格在听证会上所说的:“我们不仅仅应当研发和利用AI技术,还有责任更好地正确运用AI技术。”相信大家和小编一样期望,更多的AI公司能有自己的“原则”(如同Facebook这次所公布的《原则》),并能真正坚持这些原则,让AI更好地为人类服务。

本文属VRPinea原创稿件,转载请洽:brand@vrpinea.com

评论